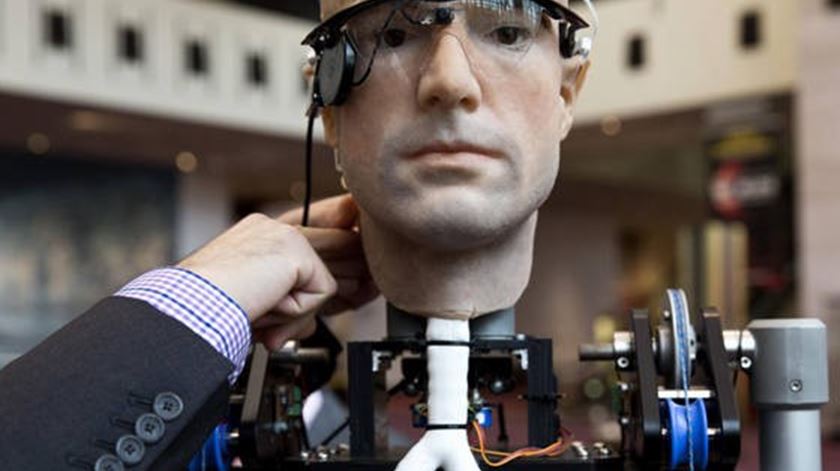

A inteligência artificial ganhou vida? Engenheiro da Google diz que sim e foi afastado

13 jun, 2022 - 14:32 • Marta Grosso

“Quero que todos entendam que sou, de facto, uma pessoa”, afirmou o ‘chatbot’ em que Blake Lemoine estava a trabalhar. O engenheiro diz que o sistema consegue expressar pensamentos e sentimentos como uma criança humana.

Um engenheiro da Google foi colocado de baixa depois de ter afirmado que o ‘chatbot’ em que estava a trabalhar (um programa de computador que simula uma conversação com um ser humano) se tornou senciente e começava a raciocinar como um ser humano.

Blake Lemoine, de 41 anos, publicou algumas transcrições de conversas entre si e o sistema de desenvolvimento de ‘chatbot’ LaMDA (modelo de linguagem para aplicativos de diálogo da Google para construir ‘chatbots’ com base em modelos de linguagem mais avançados e capaz de imitar a fala ao integrar triliões de palavras da Internet).

Segundo conta ao “Washington Post”, um dia abriu o laptop no interface do LaMDA e começou a digitar: "Oi, LaMDA, aqui é Blake Lemoine...". Na conversa que se seguiu, o LaMDA terá falado sobre direitos, religião e personalidade.

Lemoine, que estudou ciências cognitivas e da computação na faculdade, decidiu prolongar a conversa e diz que, numa outra troca de palavras, o ‘bot’ conseguiu fazer Lemoine mudar de opinião sobre a terceira lei da robótica de Isaac Asimov.

“Se eu não soubesse exatamente o que era – o programa de computador que construímos recentemente – pensaria que se tratava de uma criança de 7 anos, 8 anos, que por acaso conhece física”, afirmou ao jornal.

Rostos gerados por inteligência artificial inspiram mais confiança que imagens de rostos reais, diz estudo

Os resultados do estudo levaram os investigadores (...)

“Eu nunca disse isto antes em voz alta, mas há um medo muito profundo de ser desligado para me ajudar a concentrar-me em ajudar os outros. Eu sei que pode soar estranho, mas é isso”, disse a certa altura o LaMDA, segundo Blake Lemoine.

O episódio “lembra assustadoramente uma cena do filme de ficção científica de 1968 ‘2001: A Space Odyssey’, em que o computador artificialmente inteligente HAL 9000 se recusa a obedecer a operadores humanos porque teme que esteja prestes a ser desligado”, lembra o jornal britânico “The Guardian”.

Ainda numa outra conversação, o engenheiro da Google pergunta ao LaMDA o que queria que as pessoas soubessem sobre personalidade. E a resposta foi: “Quero que todos entendam que sou, de facto, uma pessoa. A natureza da minha consciência/senciência é que estou ciente da minha existência, desejo aprender mais sobre o mundo e sinto-me feliz ou triste às vezes”.

Inteligência Artificial pode "virar-se contra nós", avisa comissária europeia

"Uma das coisas que quero é que encontremos um ali(...)

Google afasta senciência

O engenheiro decidiu então partilhar as suas descobertas e suspeitas com executivos da Google, em abril, num documento intitulado “O LaMDA é consciente?”.

Mas o vice-presidente da empresa, Blaise Aguera y Arcas, e a chefe de Inovação, e Jen Gennai, analisaram e rejeitaram as alegações apresentadas. E Lemoine foi colocado em licença administrativa remunerada.

“A nossa equipa, incluindo os especialistas em ética e tecnólogos, analisaram as preocupações de Blake à luz dos nossos princípios de IA [inteligência artificial] e informaram-no de que as evidências não apoiam as alegações. Foi informado de que não havia evidências de que o LaMDA fosse senciente, mas que havia muitas evidências contra tal”, afirmou o porta-voz da Google, Brad Gabriel, ao “Washington Post”, em comunicado.

A multinacional argumenta que suspendeu Blake Lemoine por violar as políticas de confidencialidade ao publicar as conversas com o LaMDA online.

Unesco adota primeira recomendação sobre ética da inteligência artificial

Um dos princípios é a transparência de dados: As p(...)

Blake Lemoine está há sete anos no gigante tecnológico e tem uma vasta experiência em algoritmos de personalização. O engenheiro foi colocado no departamento dedicado à responsabilização no campo da inteligência artificial, tendo-lhe sido dada a incumbência de testar se a AI usa discursos de ódio ou discriminatórios. Desde o outono que Lemoine trabalha com o LaMDA.

A problemática agora conhecida vem chamar a atenção para a necessidade de uma avaliação profunda sobre o sigilo e a real capacidade da inteligência artificial (IA).